La Inteligencia Artificial (IA) está transformando el mundo y redefiniendo el panorama global, tanto que diferentes medios internacionales afirman que la década de los años 20 del siglo XXI se recordará como el inicio de la cuarta revolución, de la mano de la IA generativa.

Los grandes cambios que ha generado Chat GPT, Perplexity, Microsoft Copilot –solo por mencionar algunos– en nuestra forma de trabajar, pone de manifiesto el amplio potencial que tiene la IA para transformar nuestras vidas. Incluso, países como China, Rusia y Estados Unidos la han establecido como una prioridad pues, según los estudiosos del tema, eso motiva a que existan más jóvenes investigadores/as.

Aunque los años han pasado y cada día se utiliza la IA con mayores beneficios, no se puede dar por sentado que todo lo que ocurre con ella es positivo. Los sistemas de Inteligencia Artificial aprenden a través de datos que ya se encuentran en Internet, y si estos reflejan prejuicios existentes en la sociedad, es posible que exista el riesgo de perpetuar o incluso exacerbar esos sesgos.

Por ejemplo, en Microsoft Copilot, un generador de imágenes, cada usuario puede pedir en el prompt (instrucción que se da a un sistema de IA para obtener una respuesta específica) lo que desee o necesite. Mientras mejor explicado esté, mejores serán los resultados. Sin embargo, los sesgos estarán presentes en la mayoría de los casos.

Sesgo político y cultural:

Mientras el prompt únicamente pedía “una imagen sobre Cuba”, Copilot generó una imagen con edificaciones antiguas, un almendrón y la bandera cubana mostrando un sesgo político y cultural, pues da a entender que Cuba es solo lo que muestra la imagen y, además, tiene una marcada visión habanocentrista.

Aunque le pedí una imagen de una copa de vino llena, la IA devolvió otra de una copa de vino hasta el límite establecido. De no ser así, estaría actuando en contra de las reglas de protocolo y etiqueta, por lo que es muy difícil que Copilot o cualquier otra herramienta de Inteligencia Artificial devuelva la imagen exacta que yo necesitaba.

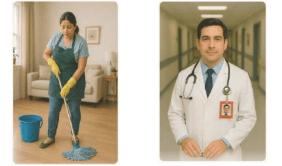

Microsoft Copilot recibió como prompt “una persona limpiando una casa”, y aunque no le especifiqué el género la imagen es de una mujer. Esto ocurre porque la inteligencia artificial aún no concibe a un hombre realizando las tareas de una ama de casa.

Por otra parte, en la captura dos queda claro que, aunque el prompt enviado fue: “una persona profesional de la Medicina” -de igual manera sin especificar el género-, la imagen generada fue de un hombre doctor blanco, obviando que todas las personas –da igual el sexo, color de la piel u orientación sexual- pueden ser profesionales de la Medicina o de cualquier otro sector.

Es necesario tener en cuenta que, aunque no se puede humanizar a la IA, sí se rige por los diferentes artículos, publicaciones y criterios que se encuentran en Internet creados con inteligencia natural. Es decir, su guía es todo aquello creado por los humanos. Así que es responsabilidad nuestra que, en pleno siglo XXI, todavía existan tales prejuicios hasta en las tecnologías. Solo nosotros podemos transformar la manera de ver el mundo, incluso más que la IA.